Новая система безопасности на основе AI от Anthropic попала в руки хакеров за считанные дни

Всего за шесть дней с момента запуска проекта кому-то удалось обойти все механизмы безопасности, разработанные для защиты модели искусственного интеллекта Anthropic.

Ян Лейке, бывший член команды по выравниванию OpenAI, ныне работающий в Anthropic, объявил на X, что один участник успешно преодолел все восемь уровней испытания. Коллективные усилия включали около 3700 часов тестирования и 300 000 сообщений от участников. Однако Лейке отмечает, что пока никто не нашел универсального джейлбрейка, который мог бы решить все уровни испытания сразу.

По мере того, как модели AI становятся более способными, их защита становится все более важной, а универсальные джейлбрейки становятся все более ценными. Эта динамика предполагает, что языковые модели могут в конечном итоге разработать собственную экосистему безопасности, похожую на ту, что существует сегодня для операционных систем.

Первоначальная версия имела два основных недостатка: она помечала слишком много невинных запросов как опасные и требовала слишком много вычислительной мощности. Хотя улучшенная версия решила эти проблемы, как показали автоматизированные тесты с 10 000 попыток джейлбрейка, некоторые проблемы все еще остаются.

Тесты показали, что в то время как незащищенная модель Claude пропускала 86% попыток манипуляции, защищенная версия блокировала более 95%. Система только неправильно пометила дополнительные 0,38% безвредных запросов, хотя ей все еще требуется на 23,7% больше вычислительной мощности для работы.

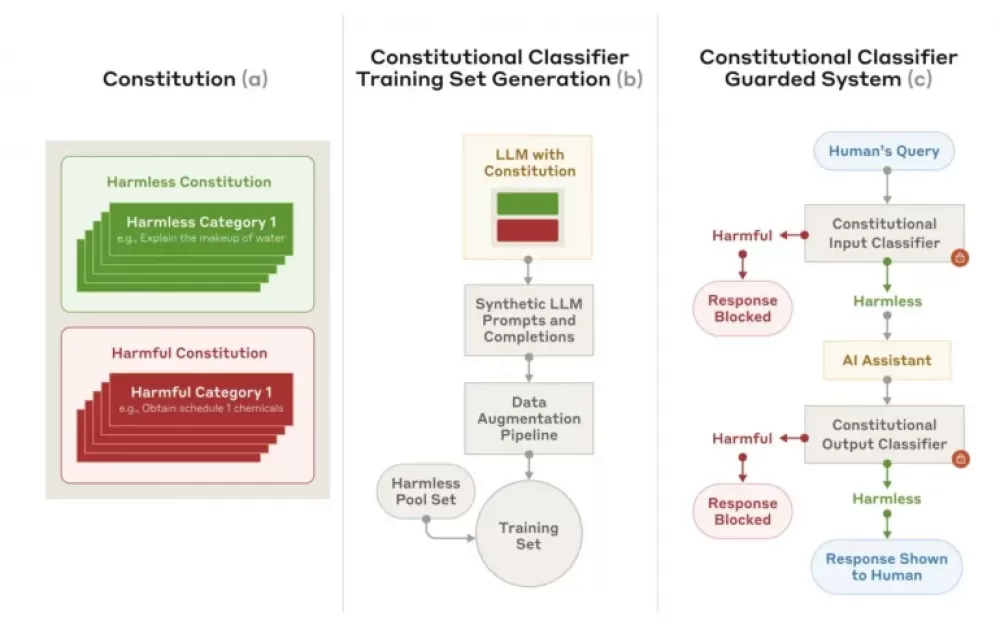

Система безопасности работает, используя предопределенные правила о том, какой контент разрешен или запрещен. Используя эту «конституцию», она создает синтетические обучающие примеры на разных языках и в разных стилях. Затем эти примеры обучают классификаторы обнаруживать подозрительные входные данные.

Исследователи признают, что система не защищена от всех универсальных взломов, и могут появиться новые методы атак, с которыми она не справится. Вот почему Anthropic предлагает использовать ее вместе с другими мерами безопасности.

Для дальнейшего тестирования надежности системы компания Anthropic выпустила публичную демо-версию. Эксперты по безопасности могут попытаться перехитрить ее с 3 по 10 февраля 2025 года, а результаты будут опубликованы в обновлении.

Источник

Написать комментарий