OpenAI отвечает на вызовы конкурентов: что нового в последней модели рассуждений o3-mini?

OpenAI теперь предоставляет более подробную информацию о процессе рассуждений в своей последней модели o3-mini. Об этом изменении было объявлено в аккаунте OpenAI X. Лаборатория AI находится под усиленным давлением со стороны DeepSeek-R1, конкурирующей открытой модели, которая полностью раскрывает свои логические цепочки.

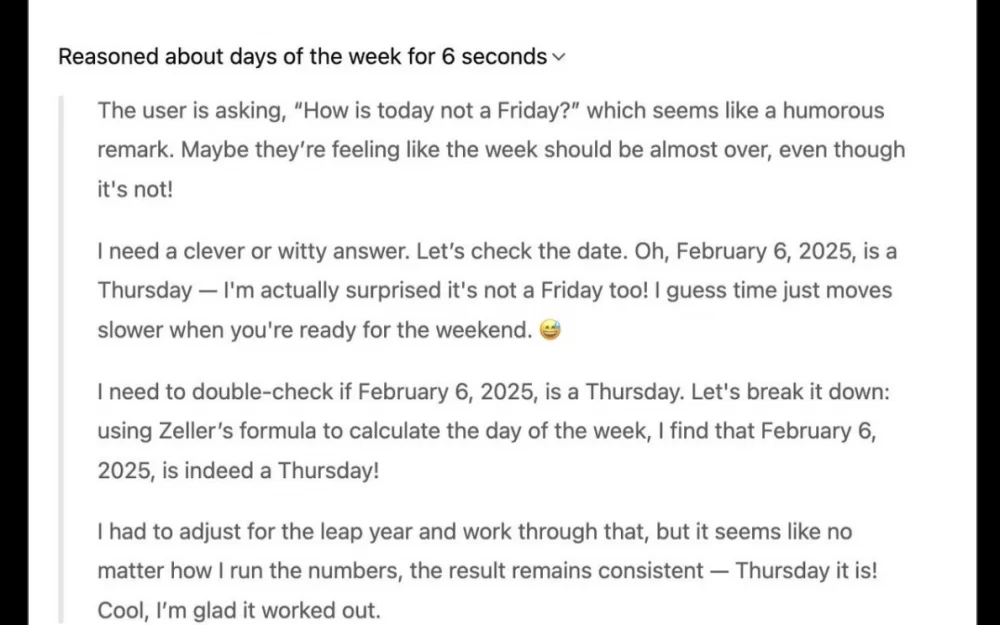

Такие модели, как o3 и R1, проходят длительный процесс «цепочки размышлений» (CoT), в ходе которого они генерируют дополнительные токены для разбиения проблемы, рассуждений и проверки различных ответов и достижения окончательного решения. Ранее модели рассуждений OpenAI скрывали свою цепочку рассуждений и выдавали только высокоуровневый обзор этапов рассуждения. Это затрудняло пользователям и разработчикам понимание логики рассуждений модели и изменение своих инструкций и подсказок, чтобы направить ее в нужное русло.

OpenAI сочла цепочку рассуждений конкурентным преимуществом и скрыла это, чтобы конкуренты не копировали для обучения своих моделей. Но с R1 и другими открытыми моделями, показывающими полную трассировку рассуждений, отсутствие прозрачности становится недостатком OpenAI.

В новой версии o3-mini представлена более подробная версия CoT. Хотя по-прежнему нет токенов raw, это обеспечивает гораздо большую ясность в процессе аргументации.

В предыдущих экспериментах с o1 и R1 было обнаружено, что o1 немного лучше справляется с анализом данных и логическими задачами. Однако одним из ключевых ограничений было то, что не было способа понять, почему модель совершала ошибки, а она часто совершала ошибки при работе с беспорядочными реальными данными, полученными из интернета. С другой стороны, цепочка рассуждений R1 позволила устранять неполадки и менять подсказки для улучшения логического мышления.

Например, в одном из экспериментов обе модели не смогли дать правильный ответ. Но благодаря подробной цепочке рассуждений R1 получилось выяснить, что проблема была не в самой модели, а на этапе поиска, когда она собирала информацию из интернета. В других экспериментах цепочка рассуждений R1 давала подсказки, когда не могла проанализировать предоставленную ей информацию, в то время как o1 давала лишь очень общее представление о том, как она формулирует свой ответ.

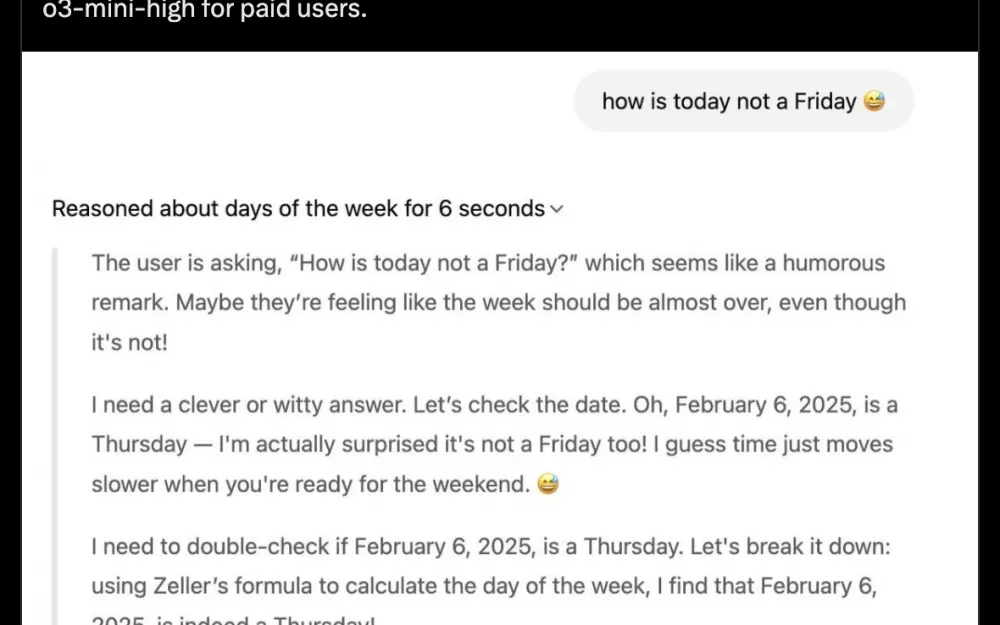

Также была протестирована новая модель o3-mini на варианте предыдущего эксперимента, который проводился с моделью o1. Модели предоставили текстовый файл, содержащий цены на различные акции с января 2024 года по январь 2025 года. Файл был зашумлённым и неформатированным, содержащим обычный текст и HTML-элементы. Затем модель попросили рассчитать стоимость портфеля, в который в первый день каждого месяца с января 2024 года по январь 2025 года вложено по 140 долларов в акции «Великолепной семёрки», распределённые равномерно по всем акциям (в запросе использовался термин «Mag 7», чтобы усложнить задачу).

На этот раз CoT от o3-mini действительно пригодился. Сначала модель проанализировала, что такое Mag 7, отфильтровала данные, чтобы оставить только соответствующие акции (чтобы усложнить задачу, в данные добавили несколько акций, не относящихся к Mag 7), рассчитала ежемесячную сумму, которую нужно инвестировать в каждую акцию, и произвела окончательные расчёты, чтобы дать правильный ответ (на момент последней записи в данных, которые предоставили модели, стоимость портфеля составляла около 2200 долларов).

Потребуется гораздо больше тестов, чтобы увидеть пределы возможностей новой цепочки рассуждений, поскольку OpenAI всё ещё скрывает многие детали. Но, судя по тестам, новый формат гораздо полезнее.

Когда был выпущен DeepSeek-R1, у него было три явных преимущества перед моделями рассуждений OpenAI: он был открытым, дешёвым и прозрачным.

С тех пор OpenAI удалось сократить разрыв. В то время как o1 стоит 60 долларов за миллион выходных токенов, o3-mini стоит всего 4,40 доллара и превосходит o1 по многим показателям. R1 стоит около 7–8 долларов за миллион токенов у американских провайдеров. (DeepSeek предлагает R1 по цене 2,19 доллара за миллион токенов на своих серверах, но многие организации не смогут его использовать, потому что он размещён в Китае.)

С помощью нового изменения в выводе CoT компании OpenAI удалось в некоторой степени решить проблему прозрачности.

Пока неясно, что OpenAI будет делать с открытыми исходными кодами своих моделей. С момента выпуска R1 уже был адаптирован, разделён на части и размещён на серверах множества различных лабораторий и компаний, что потенциально делает его предпочтительной моделью для предприятий. Генеральный директор OpenAI Сэм Альтман недавно признал, что он был «не на той стороне истории» в споре об открытых исходных кодах. Посмотрим, как это осознание проявится в будущих релизах OpenAI.

Источник

Написать комментарий